2026年12月网贷口子好下款吗,哪个容易通过?

构建精准的网贷口子筛选系统,核心在于建立一套实时数据采集、智能风控评估与动态排序的自动化架构,开发者需通过多维度数据清洗与机器学习模型,才能从海量信息中提取出真正符合用户需求的高通过率产品,该系统的开发重点不在于简单的信息罗列,而在于构建一个能够识别市场动态、评估平台风控偏好并实时匹配用户画像的决策引擎。

分布式数据采集层搭建

数据是系统的基石,构建高效爬虫是第一步,开发过程中需采用Scrapy或Selenium框架,针对各大金融论坛、官方公告及第三方聚合平台进行定向抓取。

-

反爬虫策略部署

- IP代理池管理:建立高匿代理IP池,设置随机切换机制,避免单一IP高频访问导致封禁。

- 请求头伪装:随机轮换User-Agent,模拟不同浏览器和设备的访问行为,结合Cookie池维持会话状态。

- 访问频率控制:利用Scrapy-Redis组件实现分布式爬取,通过Download Middleware对请求进行限流,模拟人类操作的时间间隔。

-

渲染处理

- 针对大量使用JavaScript渲染的网贷平台页面,需集成Headless Chrome或Firefox内核。

- 利用Splash服务处理AJAX异步加载的数据,确保抓取到页面完整渲染后的DOM结构,特别是隐藏在折叠菜单中的额度与费率信息。

数据清洗与结构化存储

原始数据往往包含大量噪声,必须经过严格的ETL(抽取、转换、加载)流程才能进入数据库。

-

非结构化数据清洗

- 正则匹配:编写正则表达式提取核心字段,如“额度范围”、“下款时间”、“通过率”等数值型数据。

- 去重算法:利用SimHash算法对文本内容计算指纹,快速识别并剔除重复或高度相似的推广软文,确保数据唯一性。

-

数据库选型与设计

- MongoDB应用:使用MongoDB存储抓取到的原始非结构化日志,利用其灵活的Schema特性适应不同平台的数据格式差异。

- MySQL结构化:将清洗后的标准化数据存入MySQL,建立包含平台ID、风控模型特征、平均审核时长等字段的宽表,便于后续关联查询。

核心评估算法与权重模型

这是系统的“大脑”,决定了能否准确识别优质口子,需开发一套基于AHP(层次分析法)的评分模型,对各个网贷平台进行量化打分。

-

多维特征工程

- 通过率因子:根据历史下款数据计算各平台的实时通过率,赋予其40%的权重。

- 时效性因子:统计从提交申请到资金到账的平均时长,时效越快得分越高,权重占比30%。

- 用户反馈因子:利用NLP(自然语言处理)技术分析社交媒体上的用户评论,提取情感倾向,识别是否存在“砍头息”或“暴力催收”等负面标签,权重占比20%。

-

动态排序逻辑

- 系统需根据当前时间节点调整算法参数,在年底资金流动性收紧时,自动提高“通过率”因子的权重,降低“额度”因子的权重。

- 针对特定时间窗口的查询需求,如筛选2026年12月好下款的网贷口子,算法应优先调用该月份的历史同期数据与近期实时数据,进行混合预测,从而输出最符合当下市场环境的推荐列表。

风控合规与安全机制

在开发过程中,必须植入严格的合规性检查模块,过滤违规平台,保障系统安全与用户权益。

-

黑名单过滤机制

- 建立动态更新的黑名单数据库,收录已被监管部门通报或存在严重合规问题的平台域名与公司名称。

- 在数据入库前进行交叉比对,一旦发现匹配项,立即中断该条数据的处理流程并标记为高风险。

-

敏感词屏蔽系统

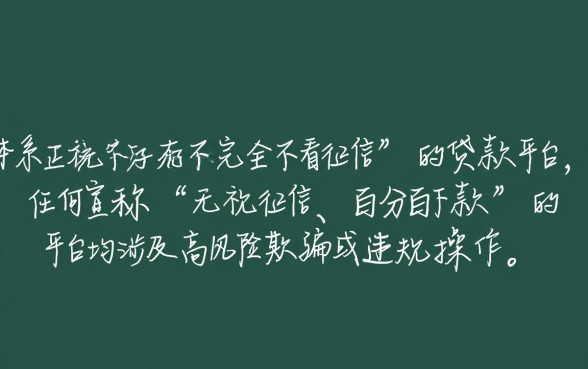

- 开发基于DFA(确定性有限自动机)算法的敏感词过滤组件,实时扫描平台宣传文案。

- 自动拦截包含“无门槛”、“黑户可下”、“不看征信”等违规夸大宣传词汇的数据,防止此类信息进入推荐队列。

前端展示与API接口开发

将处理好的核心数据通过高效接口输出,确保前端页面的加载速度和用户体验。

-

RESTful API设计

- 开发标准化的GET接口,支持分页查询和多条件筛选。

- 接口返回数据应采用JSON格式,包含平台名称、最高额度、日利率、参考通过率及专属申请链接等核心字段,减少冗余数据传输。

-

缓存策略优化

- 引入Redis缓存热点数据,将评分排名前50的口子信息缓存至内存中,设置合理的过期时间(如30分钟)。

- 利用LRU(最近最少使用)算法淘汰冷数据,确保用户在高并发访问时,接口响应时间控制在200毫秒以内。

通过上述五个步骤的系统化开发,可以构建一个技术先进、数据精准且合规性强的网贷信息聚合平台,该系统不仅能够自动筛选出优质资源,还能根据市场变化动态调整推荐策略,为用户提供最具参考价值的决策支持。

关注公众号

关注公众号